La semana pasada destacamos la censura que ejercen las compañías digitales mediante sus algoritmos. Dejar a merced de cuatro o cinco empresas la decisión de qué tiene visibilidad y qué no en la Red es peligroso. Corremos el riesgo de que acaben determinando lo que somos capaces de recordar. Continuamos el debate en n/vuestra web.

__________________________________________________

Resulta una paradoja que las redes cierren nuestras cuentas sin demasiadas explicaciones y, en cambio, resulte casi imposible ejercer el derecho al olvido digital. Consiste en borrar los mensajes compartidos o la información personal que el tiempo ha demostrado falsa o desfasada. Por ejemplo, tecleas tu nombre y lo primero que muestra Google es una acusación de pederastia o tráfico de drogas que nunca se probó o que el juez desestimó. No será fácil corregirlo ni eliminarlo. Tampoco asegurarse de que, después de cancelar la cuenta, se borraron los chistes guarros sobre niños o las fotos que compartiste "colocado".

Las empresas digitales no aplican la ley, sino el contrato privado que firmamos al aceptar "los términos" o "las condiciones de uso". Las reclamaciones y procesos legales posteriores suelen acabar en tribunales extranjeros, en la mayoría de los casos norteamericanos. De cualquier forma, exigen trámites largos y costosos. Que terminan sin la certeza de si se borra definitivamente una huella digital obsoleta o incorrecta. Lo que subimos y compartimos en la Red puede resultar, pasado un tiempo, una losa biográfica. El nuevo Reglamento General de Protección de Datos supone un avance en este sentido. Actualiza a la anterior ley en esta materia, aprobada en 1995, cuando el entramado de compañías tecnológicas dedicadas a la extracción de datos de sus usuarios no existía aún. Entre otras muchas cosas, reconoce el derecho al olvido digital en una serie de supuestos, también con excepciones.

Sin embargo, los propietarios de las redes siguen controlando la visibilidad de nuestros contenidos. Los algoritmos la aumentan, reducen o suprimen de forma automática. Ahorran tiempo de producción y costes de personal. La eficacia incentiva emplear máquinas y procesos automatizados. Así que mecánicamente permitimos que las redes determinen nuestro pasado y futuro en gran medida. También lo que recordamos y olvidamos. De nosotros mismos y como sociedad.

¿Quién aplica la censura digital? Primero los algoritmos y luego un menguado pelotón de precarios. ¿A quién rinden cuentas? Ante nadie. En todo caso, a los propietarios y accionistas. Las redes actúan de juez y parte; es decir, siempre sentencian a su favor.

En 2016 Facebook contrataba en Alemania a un equipo de 600 personas de diferentes nacionalidades para decidir los contenidos inadecuados. Para ello, subcontrató a la empresa alemana Arvato. Los trabajadores recibían 1.500 euros al mes por analizar unas dos mil imágenes al día de torturas, propaganda terrorista o pedofilia. Veían una cada 15 segundos y cobraban 8,5 euros a la hora. Estas condiciones laborales se mantuvieron en secreto, incluso ante requerimientos del gobierno alemán, hasta que los publicó la prensa. A mediados de 2017, The Guardian filtró los protocolos de censura de Facebook. Era la primera vez que se conocían desde la fundación de la empresa en 2004.

El gigante digital repitió la operación este año para afrontar uno de los temas que más de cabeza les ha traído últimamente, las fake news. En este caso, el "afortunado" lugar elegido por Facebook fue Barcelona. La empresa Competence Call Center replicará la estrategia de Facebook con Arvato en la capital catalana, en lo que también supondrá una enorme operación inmobiliaria.

El bombardeo de imágenes intolerables sobre un famélico batallón de censores puede tener efectos letales: amputar la memoria histórica de varias generaciones. Un algoritmo puede, por ejemplo, determinar la superficie de piel desnuda en una foto y la edad de su protagonista. Sin embargo, no capta la intención. ¿Es un reclamo sexual? ¿Una expresión artística? ¿O una denuncia?

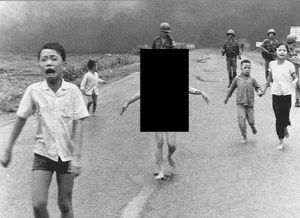

En 2016 Kim Phuc, una niña asiática de nueve años, corría desnuda por Facebook. Un fotógrafo había tomado su imagen en 1974 mientras huía de una bomba de napalm. Enarbolada como un icono contra la guerra de Vietnam, esa foto ayudó a convocar las protestas que acabaron con aquella masacre. Se aplicó a otras muchas. Simboliza el pacifismo y el antimilitarismo del siglo XX. Es un cuerpo quemado que evoca las víctimas del ardor guerrero de las "democracias".

Menos de cincuenta años después de haber sido tomada, el algoritmo de Facebook detectó la foto de Kim Phuc. Y puso en marcha la censura sistemática. Envió tres mensajes a los censores. Una persona desnuda = malo. Menor de edad = peor. Niño desnudo = pornografía infantil. Eliminarla. Borrado digital, inmediato. Al contrario de cuando nos damos de baja y pedimos eliminar el contenido de nuestra cuenta.

La redes imponen una visibilidad desigual (ellas son invisibles) y conservadora. Viralizan, hacen popular lo que ya resulta aceptado. Cuanto más se comparta, más datos recaban. En Facebook Live fue posible ver en 2017 la retransmisión en directo de un asesinato anunciado. Se detectó más tarde que la foto de la niña abrasada en Vietnam. La razón es simple: una arma es más aceptada que un desnudo.

A largo plazo, la censura digital se convierte en olvido colectivo. Supimos del caso de Kim Phuc porque la foto había ganado el premio Pulitzer y la publicaba el diario noruego de más tirada en su cuenta. Ante las protestas, de las que se hizo eco incluso la Primera Ministra noruega -que también fue censurada al publicarla en su perfil- Facebook la restituyó. Pero el incidente advierte que las redes pueden abrir vacíos en nuestra memoria histórica. Provocan amnesias generalizadas, porque borran lo que cuestiona los preconceptos o estereotipos más extendidos. Amputan la memoria rebelde.

La memoria digital, además de conformista, es cortoplazista. La última novedad sustituye el pasado anterior. Poniéndonos trágicos, un proceso abierto por una falsa violación puede destruir una feliz pareja y suponer una condena de por vida. Porque una acusación de violencia sexual despierta más atención que años de placidez conyugal. Se viralizará más y aparecerá antes en los buscadores. Otra paradoja irritante. Las redes convierten el pasado inmediato en presente que marca nuestro futuro.

Internet resucitó el sueño de refundar la Biblioteca de Alejandría que, por cierto, fue destruida antes por los bárbaros cristianos que por los árabes. Iba a renacer como un repositorio globalizado, patrimonio de la Humanidad. No porque lo declarara la UNESCO. La Historia sería, al fin, escrita por todas y todos. Dando voz a quienes perdieron las guerras. Son multitud, comparados con quienes creen haberlas ganado. En la Red las víctimas relatarían y aportarían evidencias, documentos denunciando su sufrimiento en tiempo real. Y los responsables no podrían esquivar el castigo.

La visibilidad y la memoria democráticas no llegarán de la mano de las corporaciones digitales. Pervierten, con nuestra inestimable ayuda, esa aspiración cada día que pasa. Incitan a la desnudez y a la transparencia del usuario. Pero las empresas se blindan con procedimientos ocultos. Aplican una política de visibilidad que refuerza e incrementa las desigualdades. Y que invisibiliza el verdadero protagonismo social.

Queremos ser como aquellos de quienes tenemos memoria, porque nos aportan un modelo que sirve de referencia. Las redes digitales entierran en el olvido a los desposeídos, aunque tengan la envergadura de Kim Phuc. Ella era célebre y ejerce como embajadora de la ONU. Su error fue no haberse convertido en una youtuber que promocionaba videojuegos bélicos o ropa de camuflaje.

Comentarios

<% if(canWriteComments) { %> <% } %>Comentarios:

<% if(_.allKeys(comments).length > 0) { %> <% _.each(comments, function(comment) { %>-

<% if(comment.user.image) { %>

![<%= comment.user.username %>]() <% } else { %>

<%= comment.user.firstLetter %>

<% } %>

<% } else { %>

<%= comment.user.firstLetter %>

<% } %>

<%= comment.user.username %>

<%= comment.published %>

<%= comment.dateTime %>

<%= comment.text %>

Responder

<% if(_.allKeys(comment.children.models).length > 0) { %>

<% }); %>

<% } else { %>

- No hay comentarios para esta noticia.

<% } %>

Mostrar más comentarios<% _.each(comment.children.models, function(children) { %> <% children = children.toJSON() %>-

<% if(children.user.image) { %>

![<%= children.user.username %>]() <% } else { %>

<%= children.user.firstLetter %>

<% } %>

<% } else { %>

<%= children.user.firstLetter %>

<% } %>

<% if(children.parent.id != comment.id) { %>

en respuesta a <%= children.parent.username %>

<% } %>

<%= children.user.username %>

<%= children.published %>

<%= children.dateTime %>

<%= children.text %>

Responder

<% }); %>

<% } %> <% if(canWriteComments) { %> <% } %>